在dify中使用 SiliconCloud API

结合SiliconCloud 模型多,速度快的优势,在 Dify 中快速实现工作流/Agent

使用 dify 中内置的 SiliconCloud模型的API

作为一个经常使用 dify 工作流的用户,SiliconCloud在第一时间提供了 GLM4 、Qwen2、DeepSeek V2、Yi等最新模型,且模型速度非常快,那必须第一时间对接起来!

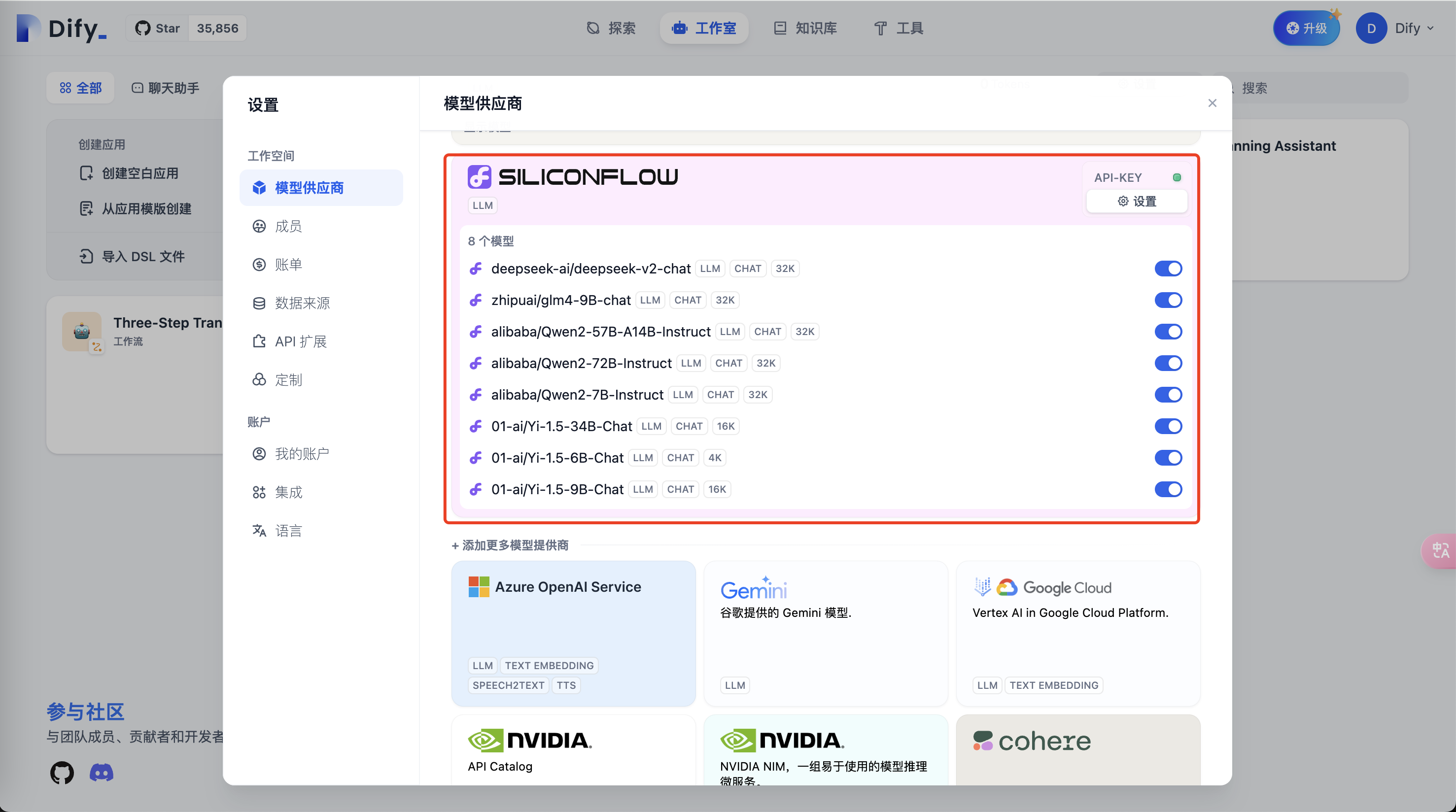

- 在进行设置,设置 SiliconCloud 平台账户的模型和 API Key 来设置大模型。

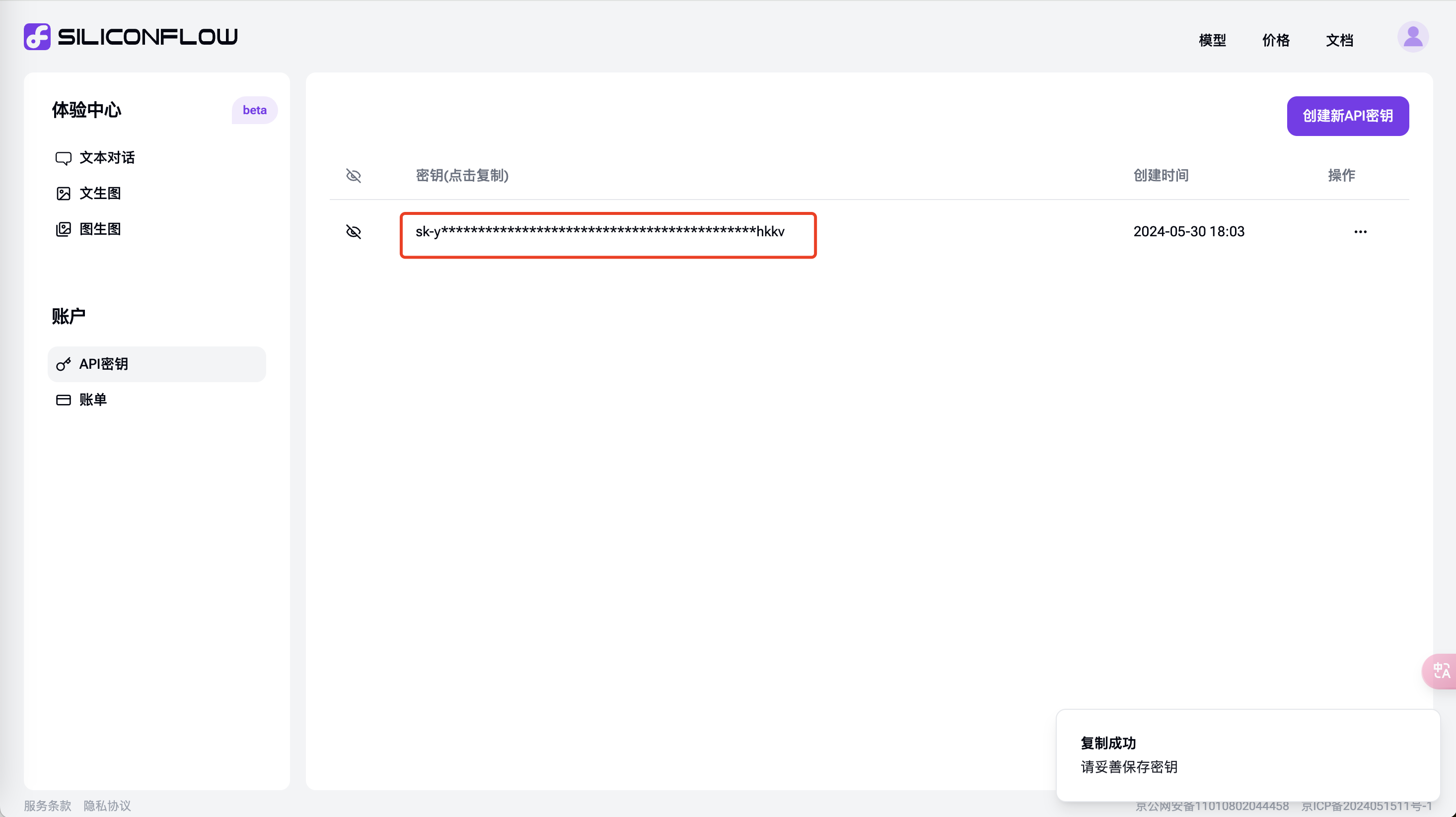

- 填入 SiliconCloud 平台的相关模型和 API Key 信息,并点击保存进行校验。使用SiliconCloud APIKey获得当前用户的 API Key,并复制到上述环境中。

- 接下来就可以在模型提供商的顶部区域看到SiliconFlow的相关模型了。

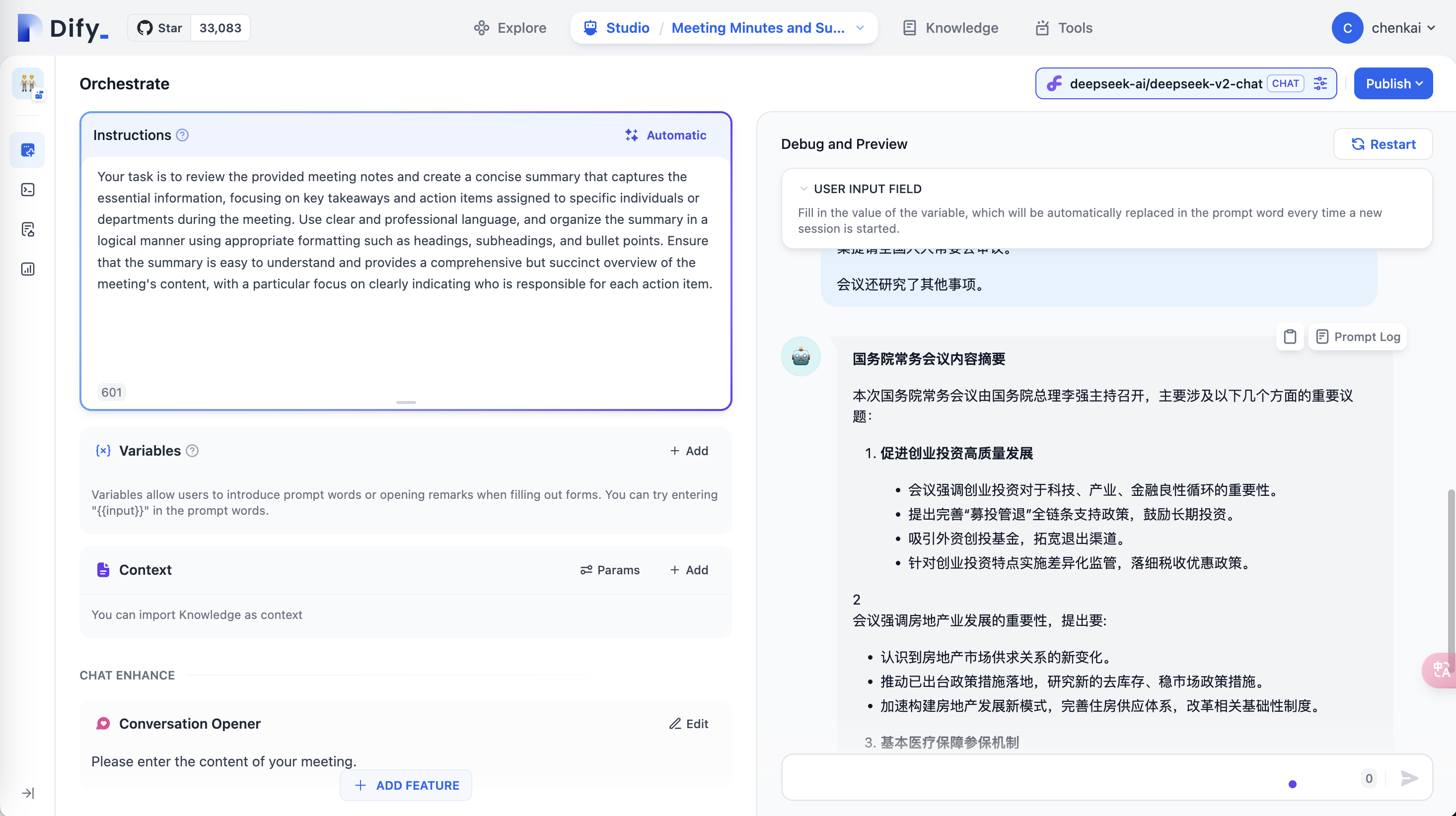

- 在应用中使用 SiliconCloud 对应的模型

经过上述步骤,您就可以在 Dify 开发应用过程中使用SiliconFlow所提供的丰富且快速的 LLM 模型了。

目前不在 dify 源代码中的 SiliconCloud 模型

目前 SiliconCloud 中还在源源不断引入新模型,因为双方迭代节奏的原因,部分模型不能第一时间在 Dify 中呈现,此处按照如下流程进行设置。

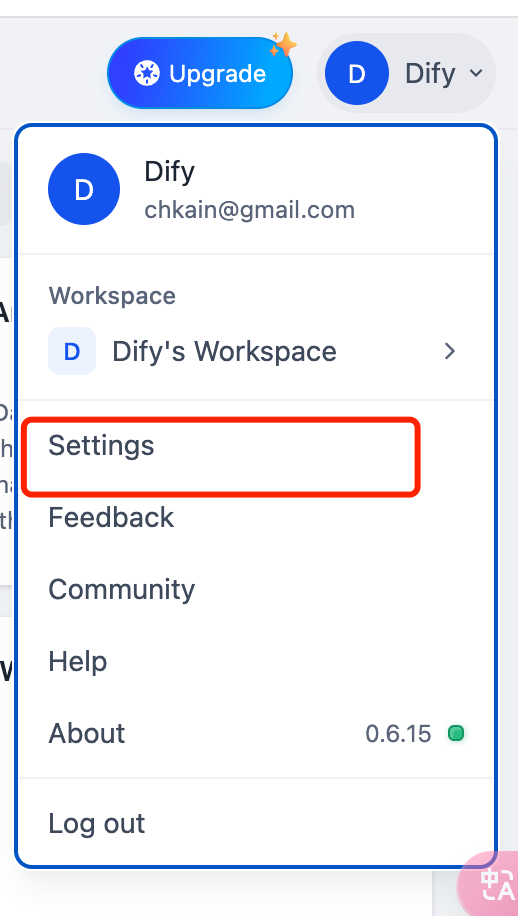

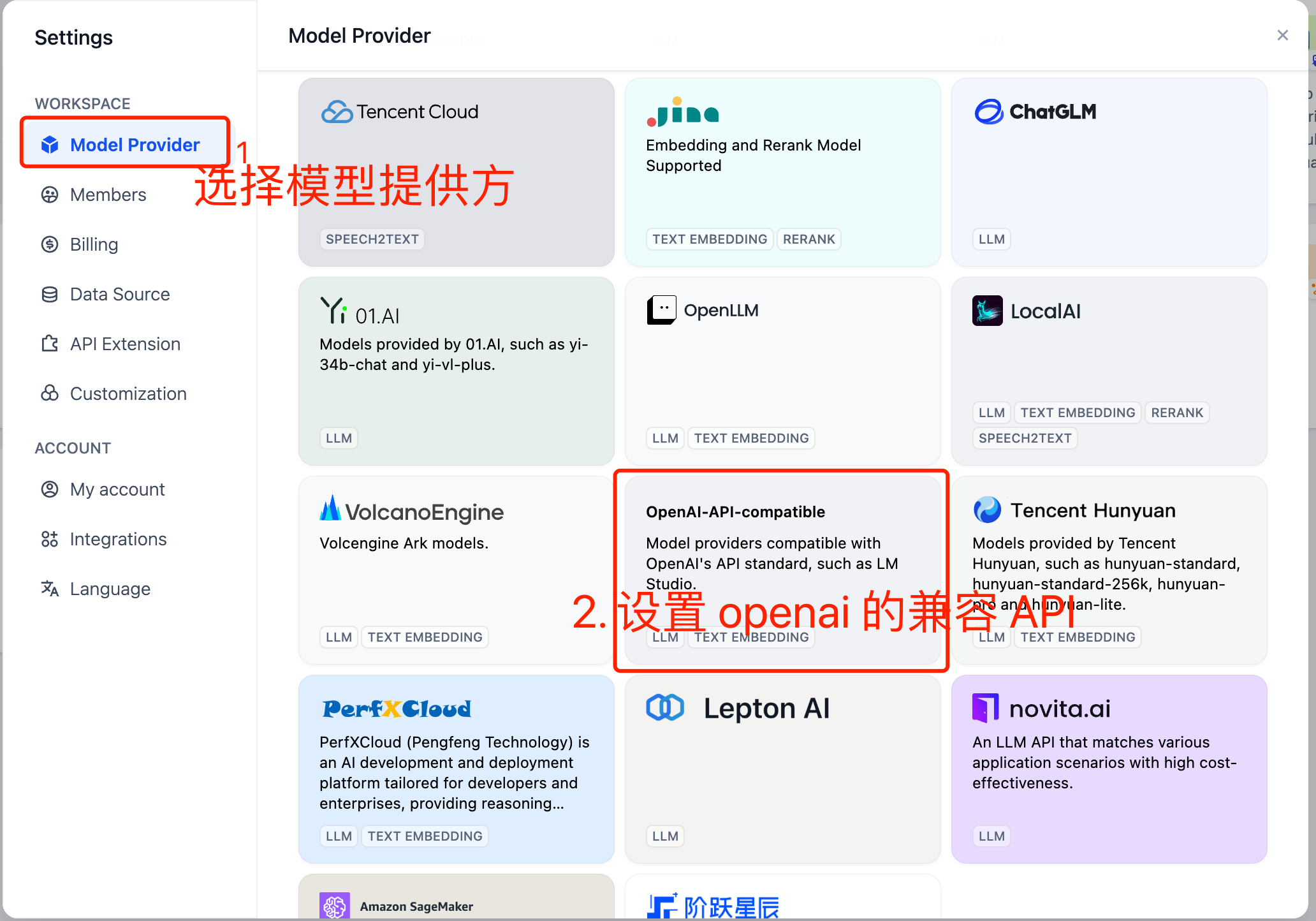

- 打开dify 的 settings 进行设置。

- 设置中选择 Model Provider 并设置“openai兼容 API”

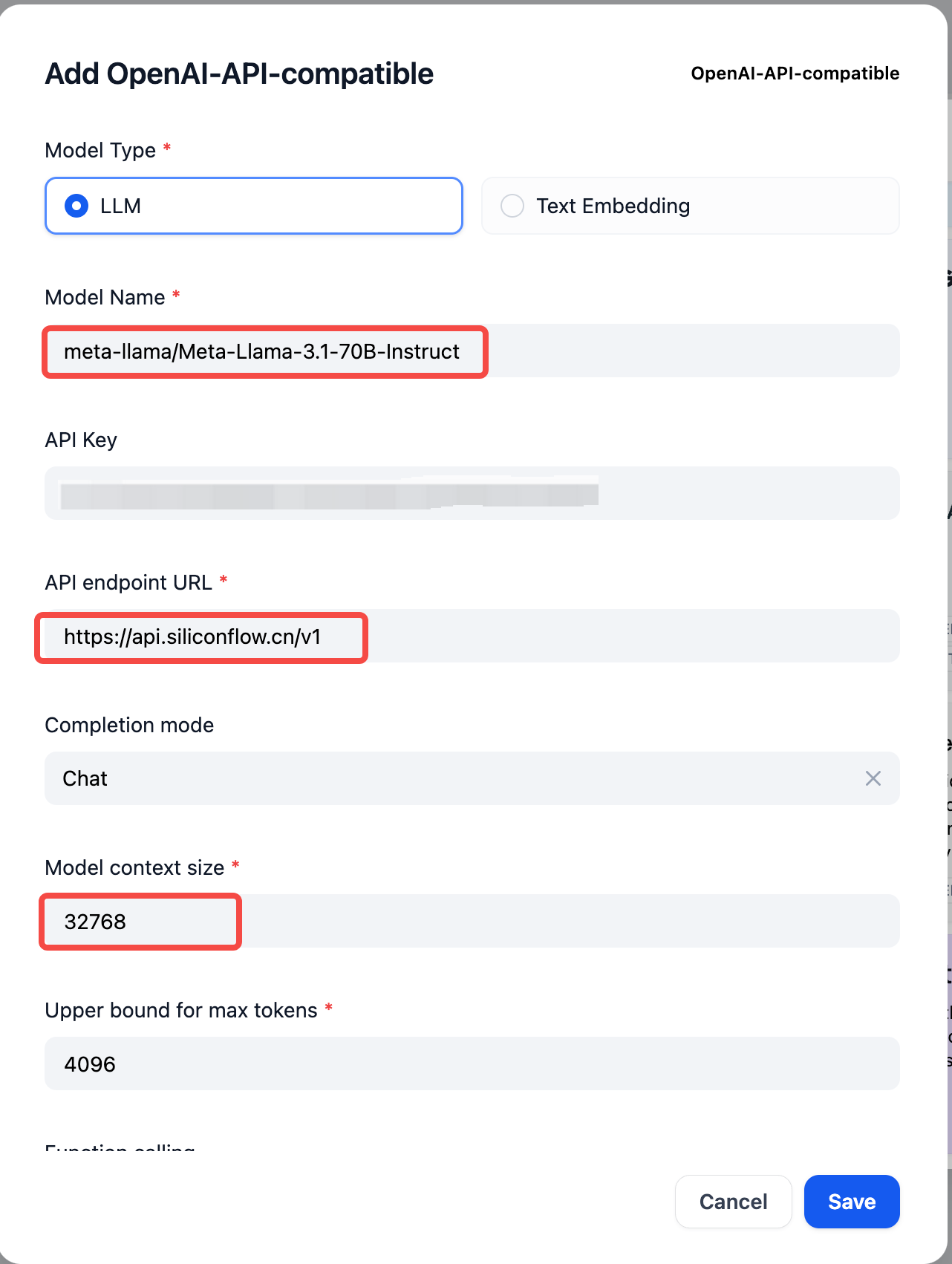

- 在其中设置对应的 SiliconCloud 对应的Model Name、API Key, API 端点 API

Model Name: 从https://docs.siliconflow.cn/reference/chat-completions-1 文档中查找。

API Key: 从https://cloud.siliconflow.cn/account/ak 中获取,请注意,如果您使用海外模型,请遵守https://docs.siliconflow.cn/docs/use-international-outstanding-models 文档规则进行实名认证。

API 端点 URL:https://api.siliconflow.cn/v1

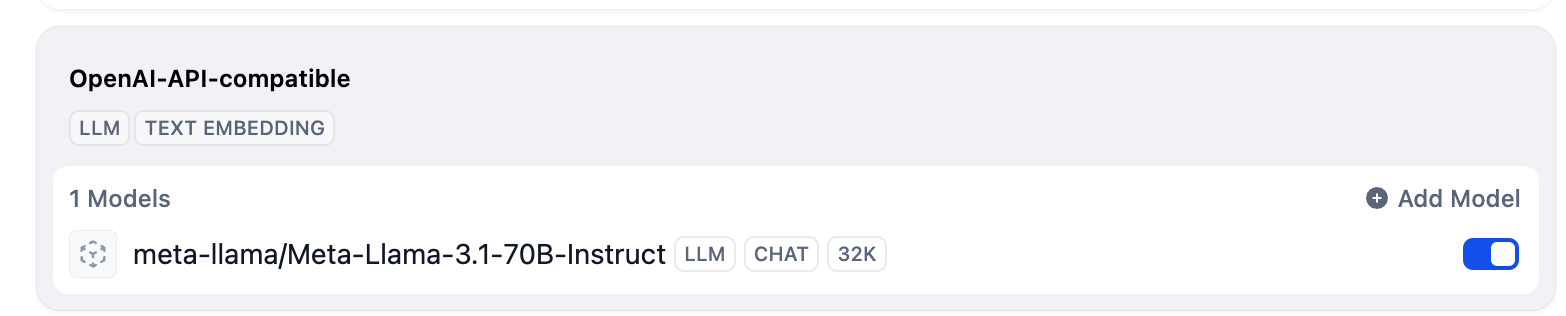

- 设置完成后,就可以在模型列表中看到上述新增的模型了。

Updated about 2 months ago